In EmbedSocial, vedo sempre lo stesso schema: I marchi sono circondati da testimonianze dei clienti, eppure i loro siti web si affidano ancora a testimonianze stantie, a screenshot manuali o a immagini obsolete. feed dei social media che non riflettono più ciò che i clienti dicono oggi.

Ecco perché il dibattito tra web scraping e API è così importante nel mio mondo.

Sulla carta, entrambi i metodi possono raccogliere dati online. In pratica, creano risultati molto diversi quando l'obiettivo è pubblicare nuove recensioni, UGC, e prova sociale su un sito web attivo.

Ho visto gruppi di lavoro iniziare con una soluzione rapida, per poi scoprire che la vera sfida non è raccolta di contenuti generati dagli utenti una volta.

La vera sfida è quella di aggregare e incorporare i post dei social media in modo affidabile, moderandoli correttamente e utilizzandoli per diventare più affidabili.

Qui di seguito spiego che cos'è il web scraping, mostro come funziona il web scraping, analizzo la differenza tra web scraping e API e spiego perché l'aggregazione sociale basata su API come EmbedSocial è di solito il modello migliore a lungo termine per i marchi.

Prima di immergersi, ecco il resoconto:

Che cos'è il web scraping?

Se qualcuno mi chiede cosa sia il web scraping, la mia risposta più semplice è questa:

È il processo di estrazione delle informazioni visibili da una pagina web e la loro conversione in dati strutturati. Uno scraper visita una pagina, legge ciò che viene visualizzato nell'interfaccia HTML o renderizzata, identifica gli elementi che desidera e salva le informazioni in un formato più utilizzabile.

‘Definizione di ’Web scraping

Tali informazioni possono includere il testo delle recensioni, i nomi utente, le didascalie, le valutazioni, i dettagli dei prodotti, gli URL delle immagini, i timestamp o altri dati di accesso al pubblico.

Per questo motivo lo scraping è molto diffuso nei flussi di lavoro che richiedono un'intensa attività di ricerca. Le aziende possono estrarre i dati per ascolto sociale casi d'uso, come il monitoraggio dei concorrenti, l'analisi delle recensioni pubbliche, il monitoraggio dei prezzi e, in alcuni casi, il monitoraggio dei prezzi, web scraping dei dati dei social media.

Voglio essere onesto: lo scraping non è intrinsecamente sbagliato o inutile.

Esso può essere pratico quando non esiste un'API adatta, o quando l'obiettivo è l'analisi interna piuttosto che la pubblicazione per i clienti.

Il problema inizia quando i team danno per scontato che un metodo creato per l'estrazione sia automaticamente valido per le operazioni in corso sui contenuti del sito web.

In base alla mia esperienza, è qui che le cose cominciano a rompersi.

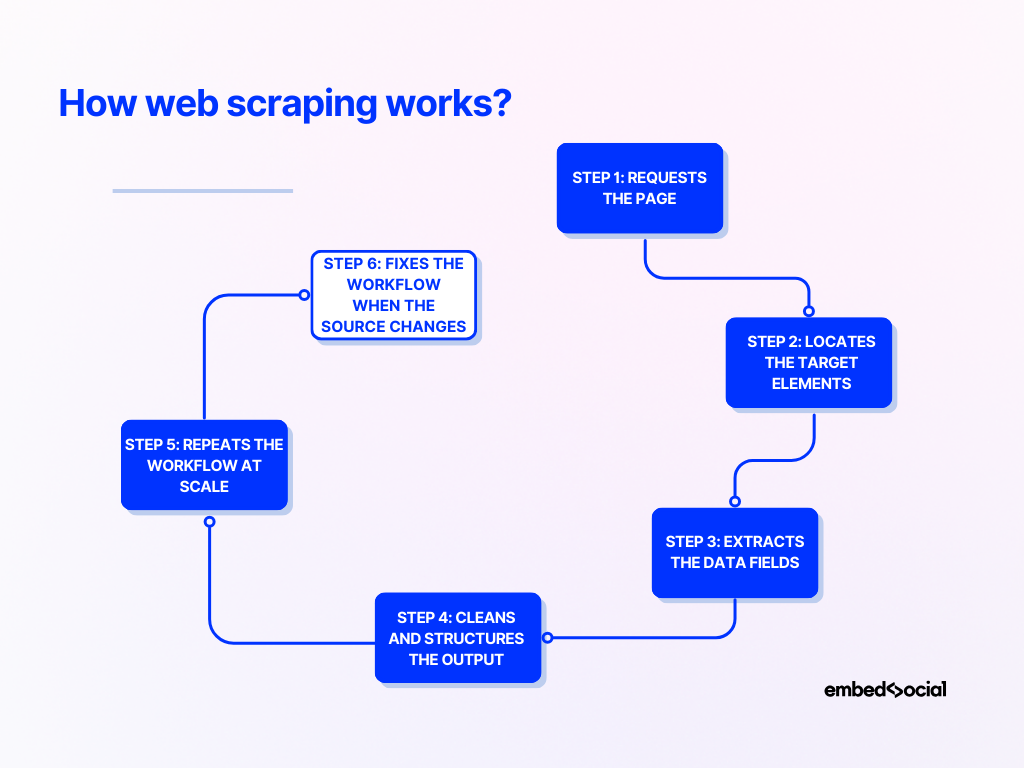

Come funziona il web scraping?

La maggior parte delle spiegazioni sul funzionamento del web scraping sono troppo astratte. Credo che sia molto più chiaro se lo si considera come un processo graduale:

Passo 1: Richiesta della pagina

Uno scraper invia prima una richiesta al sito web di destinazione e recupera il contenuto della pagina.

In casi semplici, ciò significa scaricare l'HTML grezzo. In casi più difficili, potrebbe essere necessario eseguire il rendering di JavaScript o simulare una sessione del browser.

Fase 2: Individuazione degli elementi di destinazione

Successivamente, lo scraper analizza la struttura della pagina alla ricerca dei dati necessari.

Potrebbe basarsi su Selettori CSS, nomi di classi, ID di elementi, percorsi XPath, o componenti ripetuti per trovare i giusti blocchi di contenuto.

Fase 3: Estrazione dei campi di dati

Una volta individuati gli elementi di destinazione, lo scraper estrae i campi utili.

Questo può includere didascalie, valutazioni, nomi degli autori, hashtag, link ai media, date, testo della recensione, o altri attributi visibili.

Fase 4: pulizia e strutturazione dell'output

I dati raccolti sono spesso disordinati.

Quindi il passo successivo è normalizzare le date, rimuovere i caratteri extra, rimodellare i campi e convertire tutto in un file di tipo formato strutturato come JSON o CSV.

Fase 5: Ripete il flusso di lavoro in scala

Se l'obiettivo è una raccolta continua, lo scraper viene eseguito ripetutamente su più pagine, profili, feed o URL di origine. È qui che inizia a manifestarsi l'onere della manutenzione.

Fase 6: Correzione del flusso di lavoro in caso di modifica dell'origine

Uno scraper dipende dalla struttura della pagina. Se la piattaforma di origine modifica le modalità di caricamento di didascalie, miniature o elementi della pagina, il flusso di lavoro può fallire. Questo fallimento può essere di poco conto in un rapporto interno, ma è molto più grave quando il risultato appare su un sito web pubblico.

In tal caso, è necessario regolare il raschiatore.

Esempio di vita reale:

Ho visto un feed di contenuti sociali funzionare perfettamente in fase di test, poi degradarsi silenziosamente dopo che una piattaforma ha cambiato il modo in cui le schede multimediali venivano renderizzate. Il team non ha perso solo la qualità dei dati. Il team non ha perso solo la qualità dei dati, ma anche l'esperienza di un sito web non funzionante.

Che cos'è un'API?

Un'API, o interfaccia di programmazione delle applicazioni, è un modo ufficiale per un sistema di richiedere dati a un altro in un formato strutturato.

‘Definizione di ’API

Questa definizione sembra tecnica, ma la differenza pratica è semplice.

Con lo scraping, si legge ciò che appare sulla pagina. Con un'API, si richiedere i dati attraverso un canale costruito per l'accesso al software.

Invece di analizzare il contenuto visibile del front-end, si ricevono dati strutturati direttamente da endpoint definiti, spesso in JSON.

Questo di solito rende il flusso di lavoro più facile da mantenere.

Il i dati sono più puliti, la struttura è più prevedibile, e l'integrazione è meno dipendente dall'aspetto della pagina nel browser.

Naturalmente, le API non sono perfette. Possono avere limiti, approvazioni, quote e regole controllate dal fornitore per quanto riguarda i dati disponibili.

Ma per i flussi di lavoro ricorrenti, soprattutto quelli legati a un sito web attivo, le API sono di solito una base operativa molto più solida.

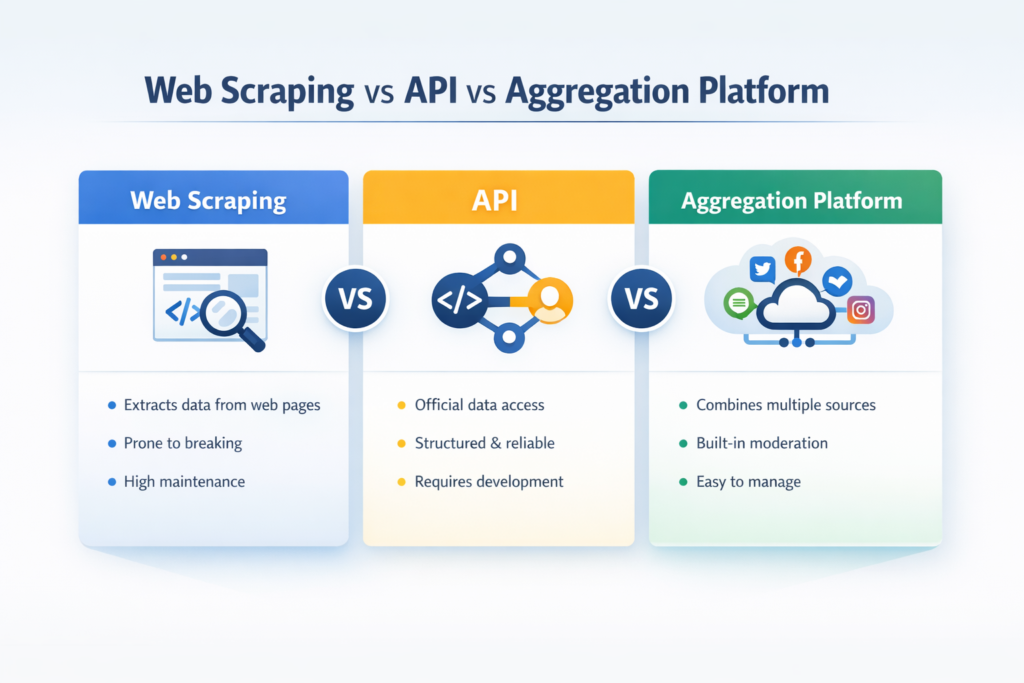

Web scraping vs API: le principali differenze in sintesi

Quando le persone cercano API vs. web scraping o web scraping vs. API, di solito vogliono un confronto veloce e pratico. Questo è il framework che uso più spesso:

| Scraping del web | API | |

|---|---|---|

| Fonte dei dati | Contenuto della pagina visibile o interfaccia renderizzata | Punto finale strutturato ufficiale |

| Formato dei dati | Grezzo o semistrutturato | Strutturato e più facile da integrare |

| Affidabilità | Vulnerabile alle modifiche del layout e del rendering | Solitamente più stabile |

| Manutenzione | Più alto | Più basso |

| Chiarezza sulla conformità | Meno prevedibile | Di solito più chiaro |

| Flessibilità | Alto per le pagine pubbliche | Limitatamente a ciò che il fornitore espone |

| La migliore vestibilità | Ricerca, monitoraggio, estrazione una tantum | Integrazioni e flussi di lavoro di pubblicazione ripetibili |

| Adatti alla riprova sociale sui siti web | Spesso fragile | Di solito molto meglio |

La vera differenza tra web scraping e API non è solo la provenienza dei dati. È anche quanto impegno viene profuso dopo la raccolta per mantenere il sistema utilizzabile, stabile e pronto per la pubblicazione.

Pro e contro del web scraping

Poiché una delle principali parole chiave di supporto è pro e contro del web scraping, voglio mostrare chiaramente questo compromesso piuttosto che semplificarlo eccessivamente.

| Professionisti del web scraping | Contro il web scraping |

|---|---|

| Può raccogliere dati pubblici anche quando non esiste un'API | Interruzioni quando il layout o il rendering cambiano |

| Altamente flessibile e personalizzabile | Richiede una manutenzione continua |

| Utile per il monitoraggio, la ricerca e l'ascolto sociale | Può affrontare sistemi anti-bot e blocchi |

| Meno dipendente dalla disponibilità dell'API del fornitore | La formattazione dei dati è spesso incoerente |

| Utile per esperimenti leggeri | Può creare rischi di policy o di governance a seconda dell'utilizzo |

| Può catturare campi visibili che le API non espongono. | Poco adatta per esperienze di sito web raffinate e rivolte al cliente |

Il mio punto di vista onesto è che lo scraping è spesso più forte quando l'output è interno. Quando l'output diventa pubblico e sensibile al marchio, le debolezze diventano evidenti.

Vantaggi dell'utilizzo delle API

Se dovessi riassumere i principali vantaggi dell'uso delle API per questo caso d'uso:

- Dati più puliti e strutturati-per esempio, quando un marchio tira e incorpora le recensioni di Google attraverso un'API, può ricevere il testo delle recensioni, le valutazioni in stelle, i nomi degli autori e i timestamp in un formato prevedibile, invece di metterli insieme da elementi disordinati della pagina;

- Minore dipendenza dal layout del front-end-Ad esempio, se una piattaforma sociale ridisegna le sue schede feed, una connessione basata su API può continuare a funzionare perché si basa sull'endpoint dei dati sottostanti piuttosto che sulla struttura visibile della pagina;

- Più adatto ai flussi di lavoro ripetibili-Ad esempio, un'azienda con più sedi può raccogliere automaticamente le recensioni fresche di decine di sedi in un'unica dashboard, invece di controllare manualmente ogni pagina una per una;

- Un supporto più forte per la freschezza e la coerenza-Ad esempio, un marchio di e-commerce può mantenere la pagina del prodotto widget di revisione aggiornate con i feedback recenti dei clienti, invece di lasciare le stesse testimonianze statiche per mesi;

- Governance e regole di accesso più chiare-Ad esempio, un team di marketing che utilizza integrazioni ufficiali ha più facilità a spiegare da dove provengono i contenuti e come vengono utilizzati rispetto a un team che si affida a pagine pubbliche scrapate;

- Meno pulizia e meno interventi di riparazione in seguito-Ad esempio, gli sviluppatori non devono continuare a correggere i selettori non funzionanti ogni volta che un sito sorgente cambia la sua struttura HTML o la resa dei media;

- Un percorso più semplice dalla raccolta alla pubblicazione-Ad esempio, un marchio può trasferire le prove sociali da fonti collegate in un carosello di homepage o in un widget di recensioni senza dover ricorrere a strumenti di scraping web inaffidabili.

In breve, le API non aiutano solo a raccogliere dati. Aiutano a costruire un sistema attorno a quei dati. L'estrazione dei dati diventa un processo affidabile che fornisce un accesso strutturato ai dati.

Inoltre, le API consentono di indirizzare le pagine del sito web per ottenere dati specifici invece di raschiare tutto da tali pagine e poi setacciare i contenuti.

Perché i dati dei social media sono diversi da quelli del web in generale?

La maggior parte degli articoli generici sul web scraping e sulle API trattano tutti i dati online come se appartenessero alla stessa categoria. In base alla mia esperienza, questo è il punto in cui l'analisi diventa troppo superficiale.

I contenuti dei social media smettono di essere ‘solo dati’ nel momento in cui appaiono su una homepage, una pagina di prodotto o un widget di recensione. A quel punto, diventano contenuti che creano fiducia.

| Caso d'uso generale dei dati web | Caso d'uso dei dati dei social media |

|---|---|

| Spesso utilizzato per l'analisi interna | Spesso utilizzato per le prove a contatto con i clienti |

| Possono essere accettati lievi problemi di formattazione | La formattazione influisce direttamente sulla percezione |

| Un'interruzione temporanea può essere scomoda | Un feed interrotto può danneggiare la fiducia |

| Di solito si concentra sul recupero | Richiede il reperimento, la moderazione e la pubblicazione |

| Spesso sono presenti in dashboard o report | Vive su siti web, widget e pagine di conversione |

| Rischio di marca inferiore se solo interno | Rischio del marchio più elevato perché i clienti lo vedono |

Ecco perché separo così nettamente questi casi d'uso. Un foglio di calcolo può tollerare un output disordinato. Un foglio di lavoro Widget UGC non può. Non vi limitate a estrarre i dati dalle pagine web, ma li reimplementate in widget per siti web vivi che creano fiducia e si aggiornano automaticamente.

Web scraping dei dati dei social media: Dove si rompe?

Il fascino del web scraping dei dati dei social media è ovvio all'inizio. I contenuti pubblici sembrano accessibili, la configurazione può sembrare veloce e i team possono credere di aver trovato una scorciatoia.

In pratica, il modello inizia a rompersi in modi prevedibili:

Le modifiche al front-end creano fragilità

Le piattaforme sociali cambiano spesso.

Un feed che dipende dalla struttura visibile della pagina può smettere di funzionare quando una didascalia viene caricata in modo diverso, un elemento multimediale viene ristrutturato o la piattaforma cambia la modalità di rendering dell'interfaccia.

Suggerimento:

Non costruite mai un feed rivolto ai clienti basandovi solo su ipotesi di layout di pagina. Se una piattaforma cambia il modo in cui le didascalie, le schede o i media vengono visualizzati, il vostro feed può rompersi da un giorno all'altro: ecco perché l'accesso ufficiale alle API è di solito la base più sicura per tutto ciò che è rivolto al pubblico.

La qualità della formattazione diventa difficile da controllare

Anche quando uno scraper funziona tecnicamente, il risultato potrebbe non essere adatto alla pubblicazione.

Ho visto contenuti sociali scraped arrivare con didascalie mancanti, scarsa resa dei media, layout delle schede non uniformi e attribuzione incompleta.

Suggerimento:

Un feed che “tecnicamente funziona” non equivale a un feed pronto per la pubblicazione. Prima di pubblicare i contenuti, assicuratevi di poter controllare in modo affidabile le didascalie, la qualità dei media, l'attribuzione, la coerenza delle schede e il comportamento di fallback in ogni layout.

La moderazione diventa un onere manuale

Una volta raccolti i contenuti, qualcuno deve ancora decidere cosa deve andare in onda.

Ciò significa Gestione UGC come filtrare lo spam, rimuovere i post irrilevanti, escludere i contenuti di bassa qualità e verificare se il risultato finale è ancora in linea con il brand.

Suggerimento:

La raccolta dei contenuti è solo metà del lavoro. Il vero successo operativo deriva dalla presenza di flussi di lavoro integrati per la gestione degli UGC, che consentono di filtrare lo spam, rimuovere i post irrilevanti, far emergere i contenuti migliori e mantenere ogni widget allineato agli standard del marchio.

La scala moltiplica i costi di manutenzione

Un mangime sperimentale è gestibile.

I feed multipli tra le pagine dei prodotti, le campagne e i siti web dei clienti comportano un onere di manutenzione molto diverso. La raccolta di dati su larga scala richiede l'accesso alle API. Se si vogliono ottenere dati affidabili su scala, è necessario accedere direttamente alla disponibilità dei dati.

Suggerimento:

Un feed sperimentale può essere gestito con lo scraping, ma la raccolta di dati su larga scala è un'altra cosa. Quando si ha bisogno di contenuti affidabili su più pagine, campagne o siti di clienti, l'accesso diretto a una disponibilità stabile di dati conta molto di più della velocità di configurazione a breve termine.

La governance diventa più difficile da gestire

A seconda della piattaforma, del tipo di contenuto e del caso d'uso, lo scraping può sollevare ulteriori questioni relative a termini, privacy, accesso e rischio del marchio.

Per molti team, questa incertezza costituisce da sola una base debole per una prova rivolta al cliente.

Suggerimento:

Se il contenuto influenzerà la fiducia o le decisioni di acquisto, il metodo di raccolta deve essere giudicato in base all'affidabilità e alla governance, non solo in base alla capacità di estrarre i dati una volta sola.

API diretta vs API di aggregazione: qual è la differenza?

Questa è la distinzione che sfugge alla maggior parte degli articoli su API e web scraping. Molti team pensano che la scelta sia semplicemente tra lo scraping e l'utilizzo di un'API.

In realtà, il confronto più utile è quello tra lo scraping, l'integrazione diretta delle API e un sistema gestito di aggregatore di social media strato.

| Cosa si ottiene | Principale svantaggio | La migliore vestibilità | |

|---|---|---|---|

| Scraping del web | Accesso flessibile ai contenuti pubblici visibili | Fragile, pesante per la manutenzione, disordinato per la pubblicazione | Ricerca, monitoraggio, esperimenti |

| Integrazione diretta con l'API | Accesso ufficiale strutturato ai dati di partenza | È ancora necessario creare una logica di moderazione, sincronizzazione, formattazione e pubblicazione. | Team tecnici con risorse di sviluppo |

| API o piattaforma di aggregazione | Accesso ufficiale più strumenti di flusso di lavoro, moderazione, organizzazione e pubblicazione | Meno controllo grezzo rispetto ai sistemi completamente personalizzati | Marchi, marketer, agenzie, team di e-commerce |

L'accesso diretto alle API è potente. Ma molti team sottovalutano ciò che viene dopo la connettività. Una volta ottenuti i dati, è necessario gestire le fonti, le regole di moderazione, la logica di trasformazione, i cicli di aggiornamento, la generazione di widget, il controllo del layout e la manutenzione continua.

Ecco perché continuo a ripetere lo stesso punto: l'accesso grezzo non è la stessa cosa di una pipeline di social proof funzionante. Avete bisogno di una aggregatore di social media come EmbedSocial.

Quando il web scraping ha ancora senso?

Non credo che un articolo credibile sul web scraping e sulle API debba fingere che lo scraping non abbia alcun ruolo. È assolutamente vero. Un buon esempio è ascolto sociale.

Se un team vuole monitorare le conversazioni pubbliche, esplorare le discussioni visibili o raccogliere dati per l'analisi interna, lo scraping può essere pratico ed efficiente.

Un altro esempio è il pubblico di nicchia raccolta dati.

A volte le informazioni necessarie sono pubbliche, ma non esistono API utili. In questi casi, lo scraping può essere l'unica strada realistica per ottenere i dati.

Penso anche che lo scraping possa avere senso per esperimenti interni leggeri.

Se il flusso di lavoro è temporaneo, il team ne comprende la fragilità e non dipende nulla dal cliente, il compromesso può essere accettabile.

Ma una volta che il contenuto diventa parte dell'esperienza pubblica del marchio, di solito consiglio ai team di elevare lo standard. È qui che lo scraping inizia a diventare un problema.

Perché l'aggregazione sociale basata su API è il sistema migliore a lungo termine per i brand?

È qui che il business case diventa molto più chiaro. Un modello di aggregazione basato su API è migliore per i marchi perché risolve più della raccolta.

Aiuta a gestire l'intero ciclo di vita dei contenuti dopo la raccolta.

Prendiamo ad esempio un marchio di e-commerce in crescita.

Potrebbe volere recensioni recenti sulle pagine dei prodotti, UGC sulle landing page e social proof sulla homepage. Cercare di mantenere tutto questo attraverso soluzioni sparse crea rapidamente problemi. L'aggregazione centralizzata basata su API rende questo sistema gestibile.

Un'attività di servizi è un altro buon esempio.

Sostituire le schermate statiche dei testimonial con contenuti di recensioni dal vivo può far sembrare il sito più attuale, più credibile e più allineato con ciò che i clienti stanno dicendo in questo momento. Immaginate un muro dell'amore pagina del vostro sito web che si aggiorna automaticamente.

Mi interessa anche la quantità di lavoro che un sistema crea dietro le quinte. Un buon flusso di lavoro riduce gli screenshot, la cura manuale, i ticket ripetitivi per gli sviluppatori e le correzioni di emergenza.

Un esempio dal mio lavoro presso EmbedSocial:

Ho visto aziende sostituire un blocco di testimonianze ormai obsoleto con un flusso live di recensioni recenti su Google e di menzioni sui social. Il risultato non è stato solo un contenuto più fresco. Il sito sembrava più attivo, più attuale e più credibile.

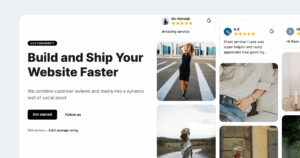

Come EmbedSocial trasforma la riprova sociale in una risorsa viva del sito web?

Questa è la parte che conosco meglio per esperienza diretta.

A EmbedSocial, L'obiettivo non è solo quello di aiutare i marchi a raccogliere contenuti. È quello di aiutarli a trasformare i contenuti reali dei clienti in qualcosa di organizzato, moderato e pronto per la pubblicazione.

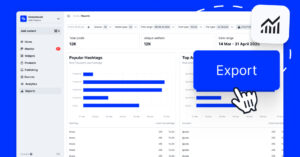

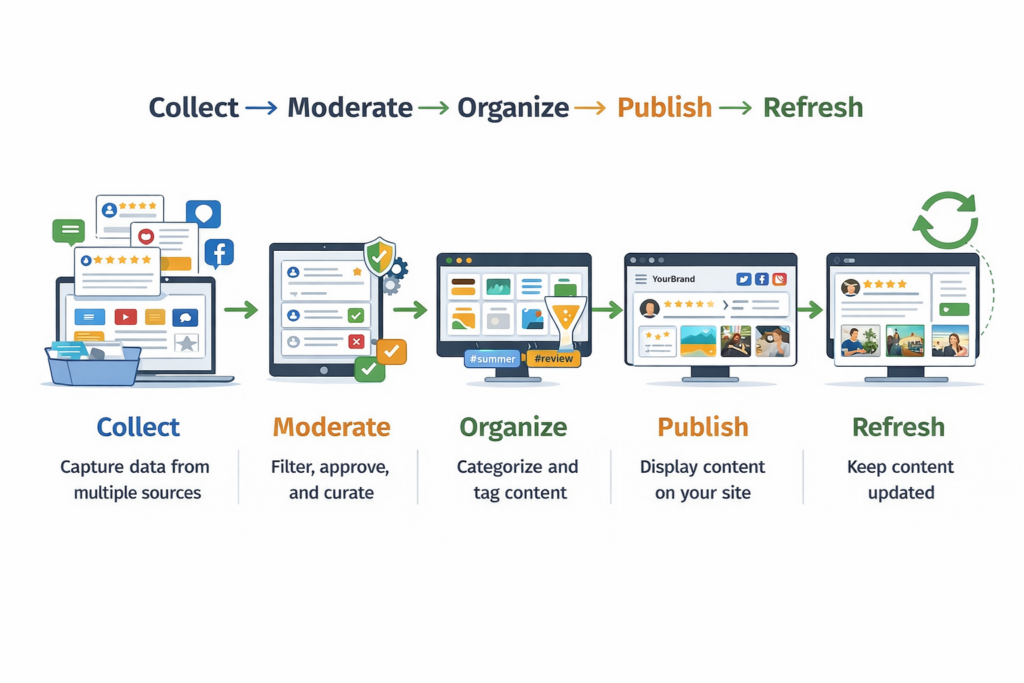

Ecco un semplice grafico che illustra il processo di aggregazione dei contenuti dei social media:

Ed ecco i passaggi da completare dopo creare il proprio account EmbedSocial:

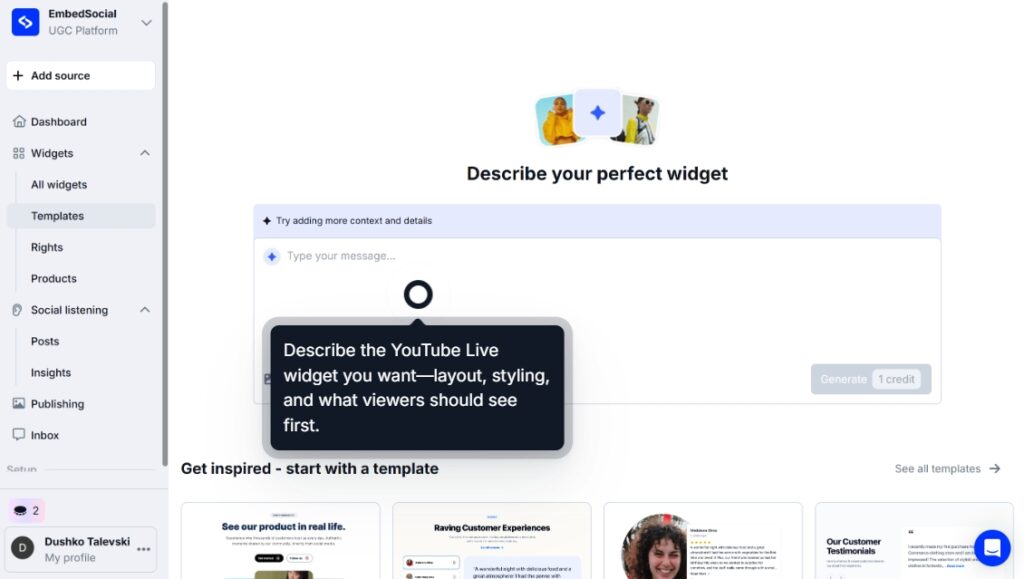

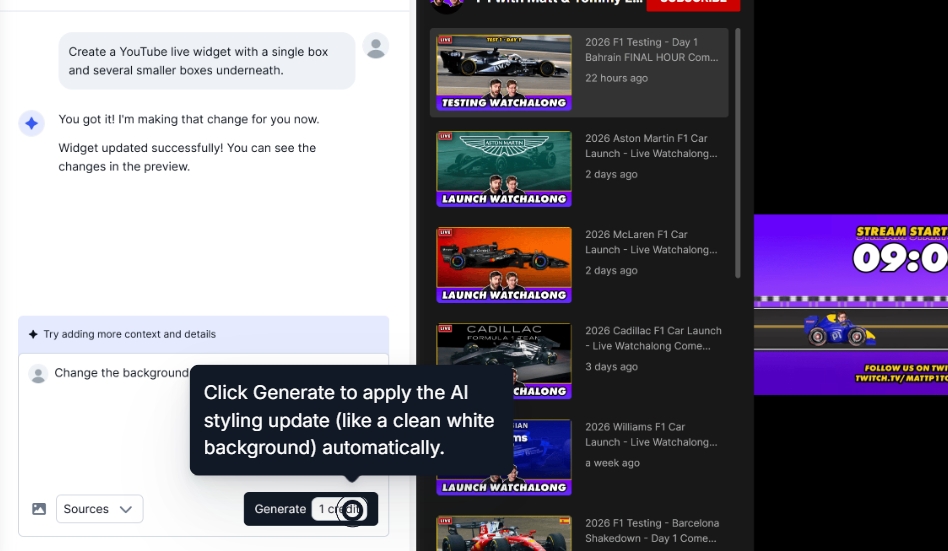

Passo 1: inviare una richiesta di progettazione di un widget AI

Per prima cosa, è necessario richiedere all'editor di widget AI di creare il nuovo widget per i social media:

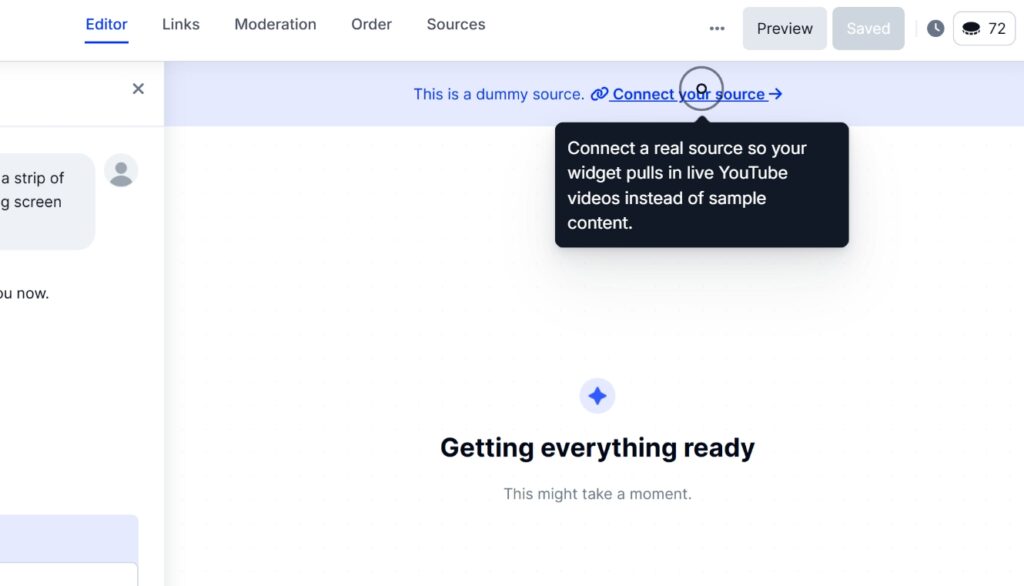

Fase 2: Collegare le fonti dei social media

Poi, dovete collegarvi ai vostri social media per estrarre i loro contenuti in EmbedSocial:

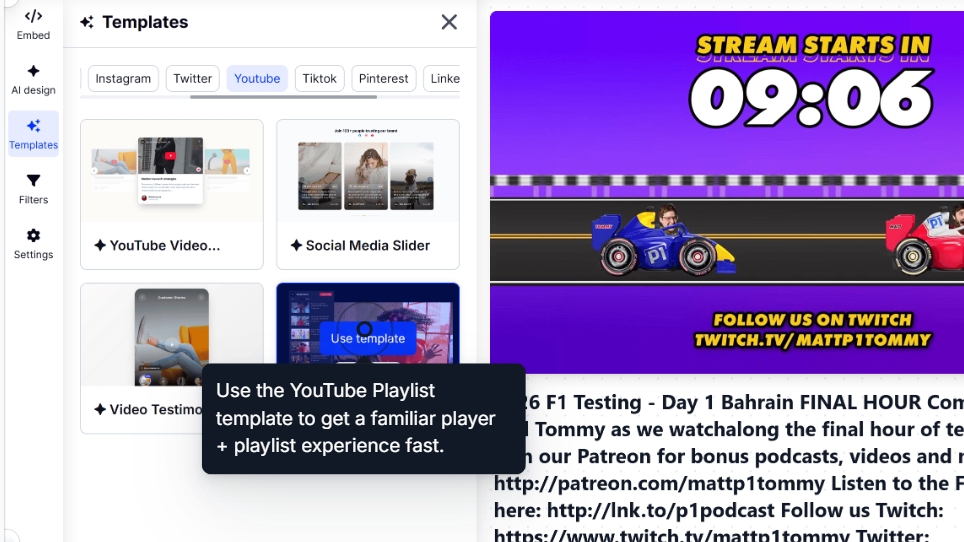

Fase 3: Progettazione e personalizzazione del widget

Quindi, è possibile selezionare il modello di widget e personalizzarlo ulteriormente tramite i suggerimenti dell'intelligenza artificiale:

Se non si è soddisfatti dell'aspetto del widget, è sufficiente navigare nel design dell'AI e aggiungere altri suggerimenti:

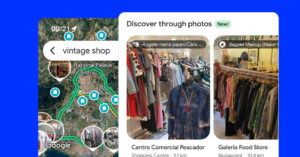

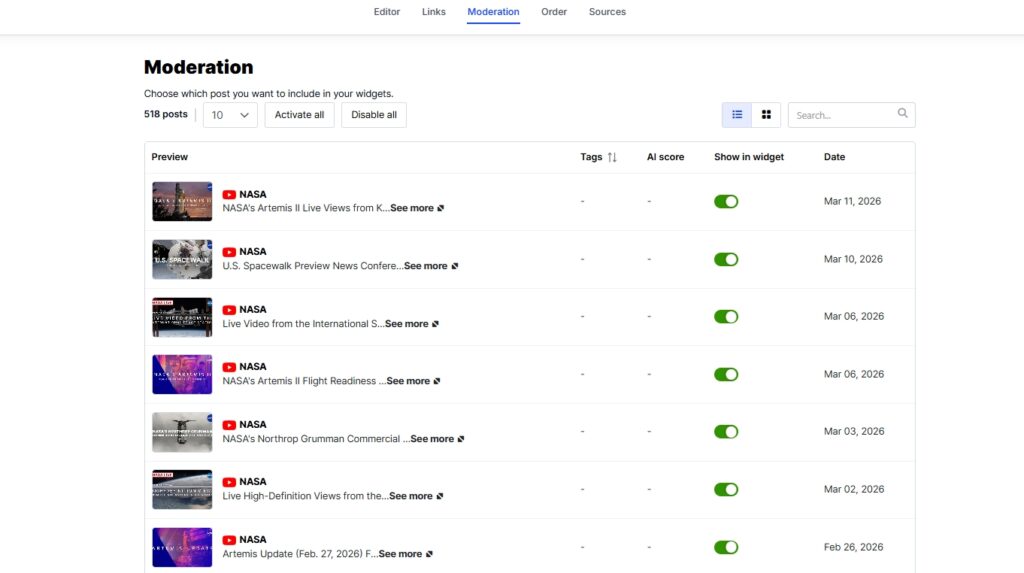

Passo 4: Moderare i contenuti del widget

Andate a visitare il sito Moderazione per selezionare i post specifici che si desidera mettere in mostra:

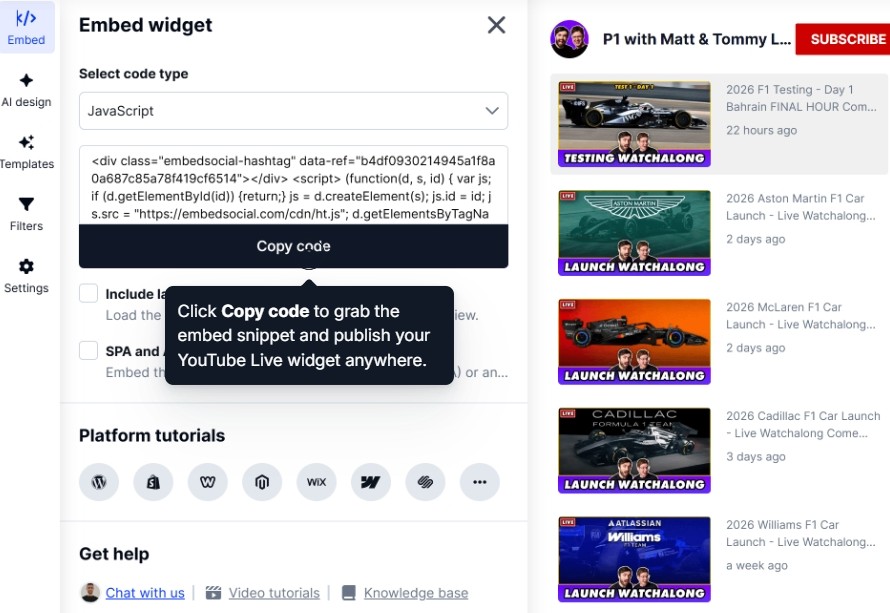

Passo 5: pubblicare i widget sul sito web

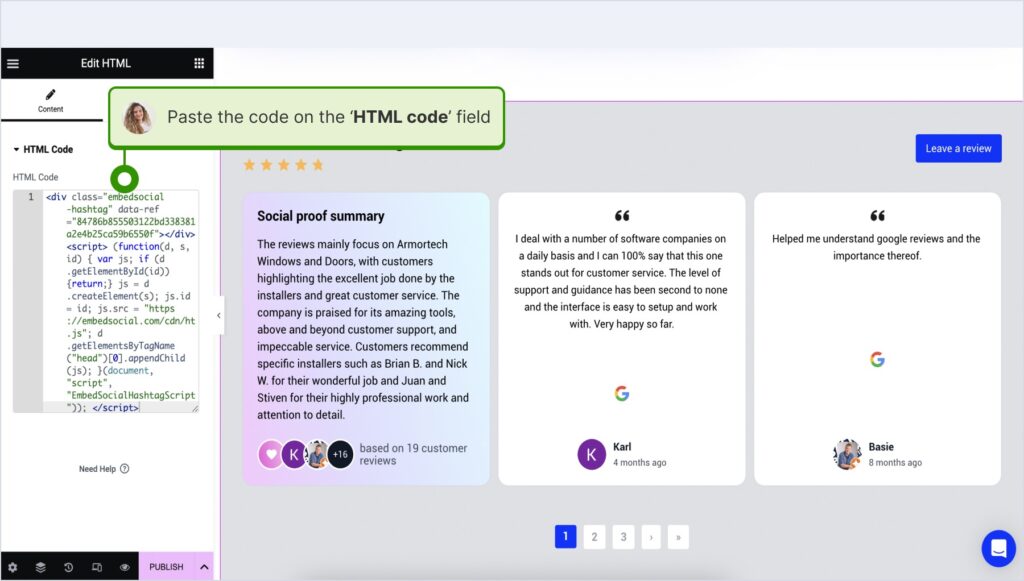

Una volta che il widget o il feed è pronto, è necessario copiare il suo codice incorporabile tramite il pulsante Incorporato scheda:

Fase 6: Incollare il codice del widget sul proprio sito web

L'ultima cosa da fare è navigare nel vostro website builder e incollare il codice del widget.

Ecco come funziona per tutti i costruttori di siti web più diffusi:

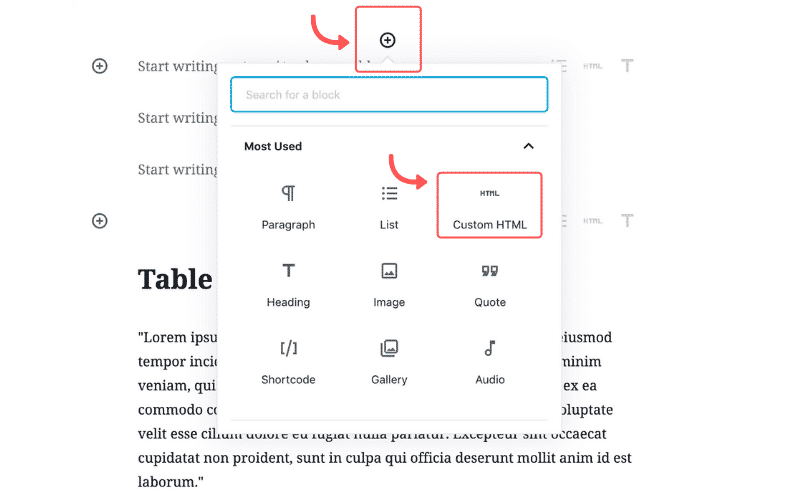

Come incorporare UGC su WordPress?

Ecco come incorporare UGC nei siti WordPress:

- Una volta creato il widget EmbedSocial, accedere alla pagina di amministrazione di WordPress;

- Accedere al proprio account e aprire la pagina in cui si desidera aggiungere il widget UGC;

- Fare clic sul pulsante + pulsante nell'editor e scegliere HTML personalizzato per incollare il codice del widget;

- Clicca "Risparmiare" quando avete finito.

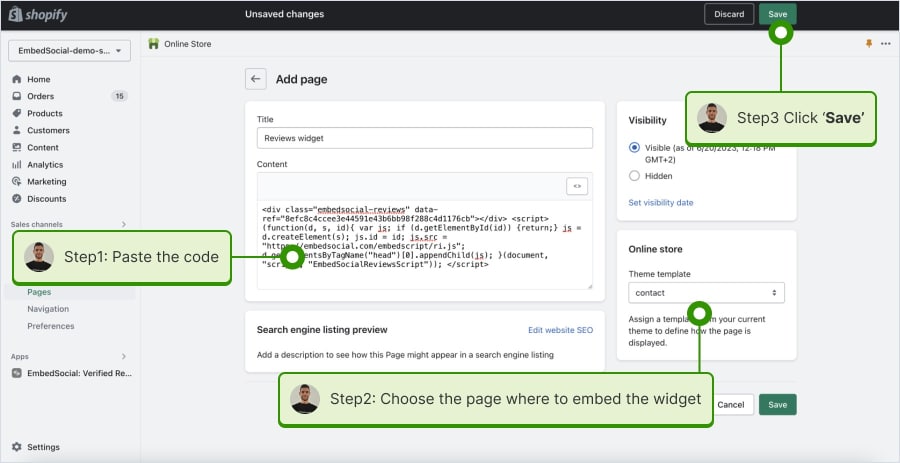

Come incorporare UGC su Shopify?

Ecco come incorporare UGC sui siti Shopify:

- Accedere al proprio account Shopify dopo aver copiato il codice del widget incorporabile in EmbedSocial;

- Passare alla sezione 'Pagine' e fare clic su Aggiungi pagina;

- Nel Contenuto pagine il codice incorporabile;

- Selezionate la pagina in cui volete che appaia il codice e premete 'Salva'.

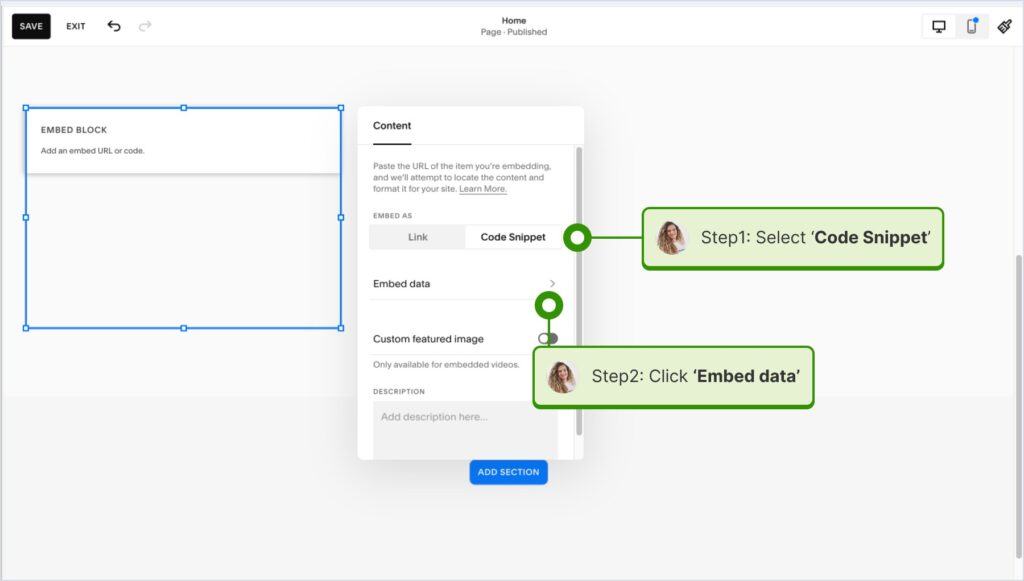

Come incorporare UGC su Squarespace?

Ecco come incorporare UGC nei siti Squarespace:

- Copiare il codice del widget EmbedSocial e accedere al proprio account Squarespace;

- Scegliete la pagina in cui volete che appaiano le recensioni;

- Cliccare Aggiungi una nuova sezione e poi Aggiungi blocco dove si vuole visualizzare il widget;

- Dall'elenco dei blocchi, scegliere 'Incorporato‘;

- Fare clic sul blocco, selezionare ‘Codice", e fare clic su ‘Incorporare i dati";

- Infine, nella casella del codice, incollare il codice delle recensioni copiato;

- Assicurarsi di salvare e pubblicare le modifiche su Squarespace.

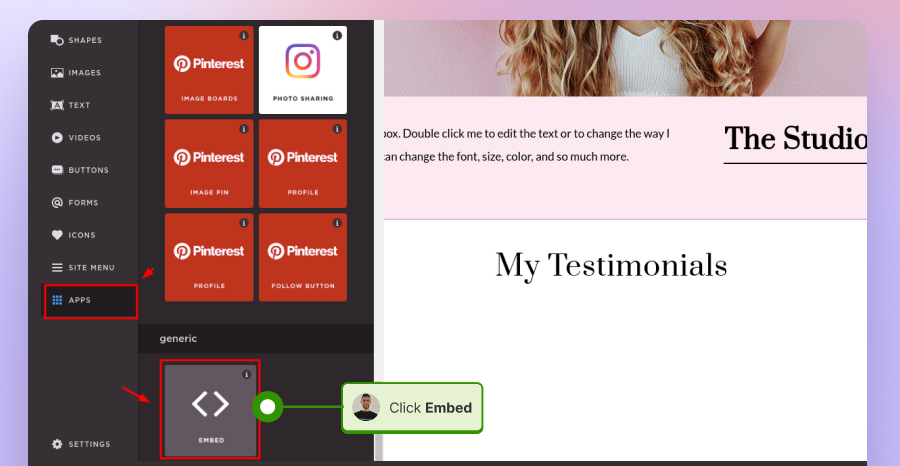

Come incorporare UGC su Wix?

Ecco come incorporare UGC nei siti Wix:

- Accedere all'editor di Wix e scegliere la pagina e la posizione in cui aggiungere il widget;

- Fare clic sul pulsante "Icona "+ nell'angolo in alto a sinistra per aggiungere un nuovo elemento;

- Trova il Embed & Social e toccare Codice incorporato;

- Incollare il codice e toccare 'Aggiornamento'.

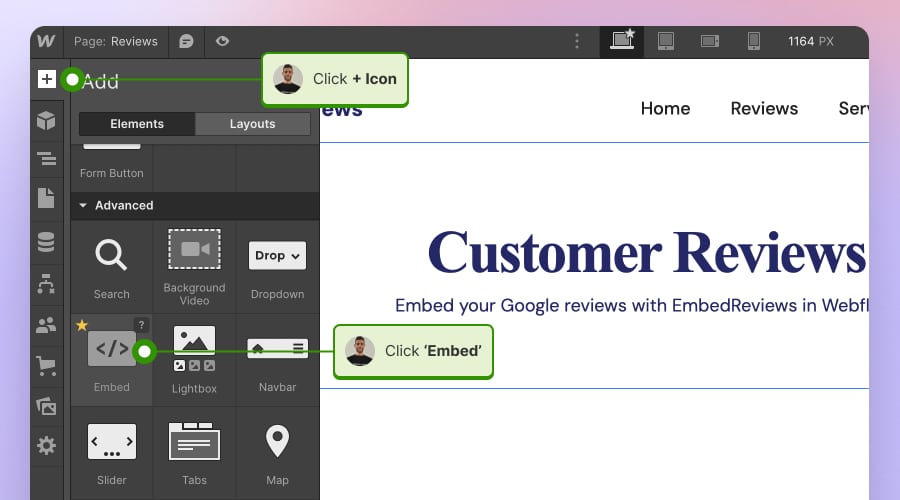

Come incorporare UGC in Webflow?

Ecco come incorporare UGC nei siti Webflow:

- Dopo aver creato il widget in EmbedSocial, accedere al proprio account Webflow;

- Andate alla vista di modifica del vostro sito web all'interno di Webflow;

- Scegliere di 'Aggiungi elemento' in Webflow e selezionare l'opzione Elemento 'Embed;

- Trascinatela e rilasciatela dove volete che appaiano le vostre recensioni;

- Nel campo di inserimento, incollare il codice EmbedSocial copiato.

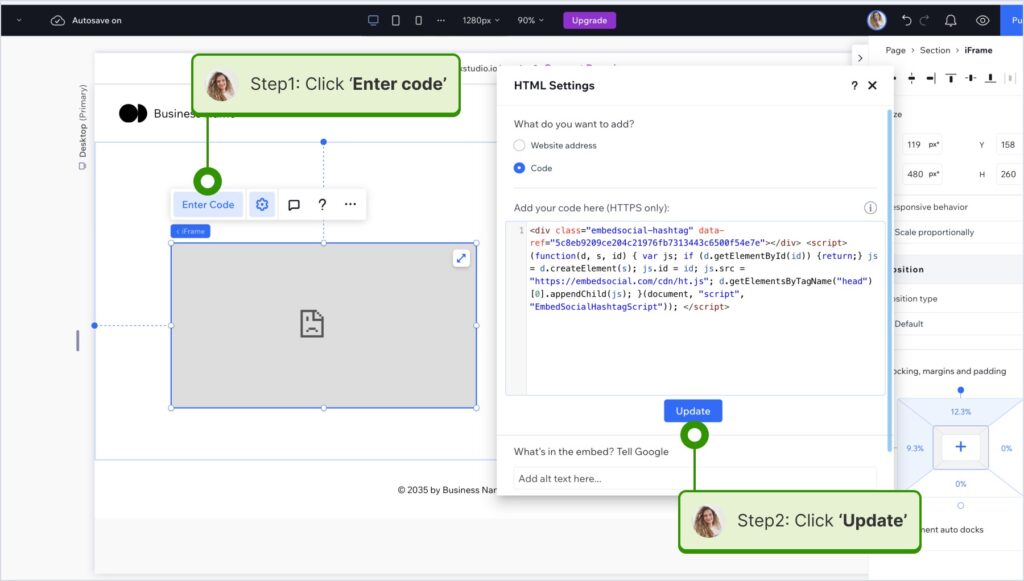

Come incorporare UGC su Pagecloud?

Ecco come incorporare UGC nei siti Pagecloud:

- Dopo aver copiato il codice EmbedSocial, accedere al proprio sito web Pagecloud conto;

- Iniziare a modificare la pagina web in cui si desidera che appaiano le recensioni;

- Toccare 'App' dal menu della barra multifunzione di sinistra e selezionare 'Incorporare';

- Incollare il codice EmbedSocial nel campo a comparsa e fare clic su 'Ok' per completare il processo.

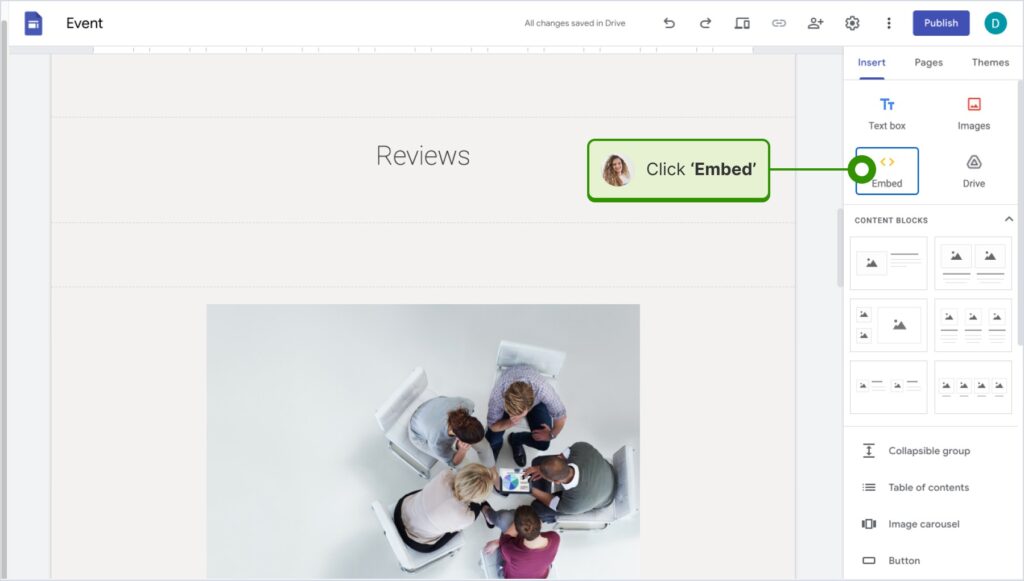

Come incorporare UGC su Google Sites?

Ecco come incorporare UGC su Google Sites:

- Una volta copiato il codice del widget incorporabile in EmbedSocial, accedere al proprio account Google Sites;

- Navigare alla pagina in cui si desidera incorporare il widget;

- Utilizzare il Scheda "Inserisci in Google Sites e scegliere dove posizionare il widget;

- Scegliere 'Incorporato' dal menu e incollare il codice copiato nella finestra di dialogo;

- Clicca 'Avanti' e poi 'Inserire' per finalizzare l'incorporazione.

Come incorporare UGC in Elementor?

Ecco come incorporare UGC in Elementor:

- Effettuare il login e navigare nella pagina in cui si desidera aggiungere le recensioni;

- Toccare una sezione vuota e scegliere l'opzione Blocco 'HTML dalla sezione della barra multifunzione di sinistra;

- Trascinarlo sulla pagina e incollare il codice del widget nel campo vuoto;

- Aggiornare e pubblicare la pagina per vedere il widget dal vivo.

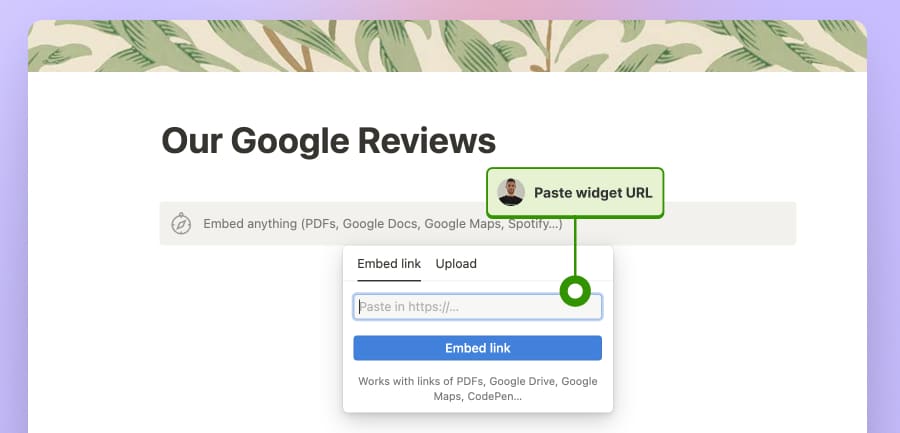

Come incorporare UGC in Notion?

Ecco come incorporare UGC in Notion:

- Dopo aver copiato il codice del widget, accedere a Notione andare alla pagina corrispondente;

- Digitare il /embed e, dal menu a tendina, scegliere l'opzione Opzione "Incorpora;

- Incollare l'URL e fare clic su "Incorpora link". per aggiungere le vostre recensioni a Notion.

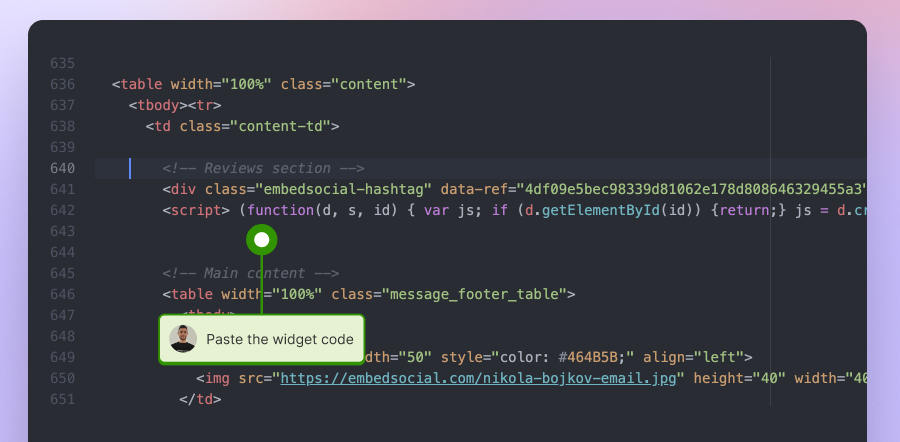

Come incorporare UGC nei siti web HTML?

Ecco come incorporare UGC in siti HTML

- Copiare la recensione del widget EmbedSocial dal file Scheda "Incorpora nell'angolo superiore sinistro dell'editor;

- Aprite il file HTML del vostro sito web, che può essere una nuova pagina o una pagina esistente;

- Incollare il codice EmbedSocial copiato nel punto in cui si desidera visualizzare le recensioni.

Conclusione: Utilizzate le piattaforme UGC con accesso alle API per costruire un flusso di lavoro affidabile di social proof!

Il motivo per cui web scraping vs API rimane una questione così comune è semplice: entrambi i metodi possono aiutare a raccogliere dati online. Ma per i marchi, questo quadro è ancora troppo ristretto.

La domanda migliore è come trasformare i contenuti dei social media in un'esperienza stabile, affidabile e rivolta al cliente, che mantenga il sito web fresco nel tempo.

Dal mio punto di vista, lo scraping ha ancora un posto nella ricerca, nel monitoraggio e nell'analisi esplorativa. Ma quando l'obiettivo è la pubblicazione di prove sociali su un sito web reale, un flusso di lavoro di aggregazione basato su API è di solito la risposta più intelligente a lungo termine.

Questo approccio offre più di un accesso.

Vi offre struttura, moderazione, coerenza e un percorso realistico per passare dai contenuti sparsi dei clienti ai widget del sito web che creano effettivamente fiducia.

Domande frequenti su web scraping e API per i contenuti dei social media

Qual è la differenza tra l'utilizzo di un'API e il web scraping?

La differenza principale tra web scraping e API è la modalità di accesso ai dati.

Il web scraping estrae le informazioni da ciò che appare su una pagina web, mentre un'API fornisce dati strutturati attraverso un punto di accesso ufficiale progettato per l'integrazione del software.

L'utilizzo di un'API è meglio del web scraping?

Quando i team confrontano API e web scraping, la risposta dipende dal caso d'uso.

Per la ricerca o il monitoraggio una tantum, lo scraping può avere senso. Per i flussi di lavoro ripetibili e i contenuti dei siti web rivolti ai clienti, le API sono di solito la scelta migliore.

Che cos'è il web scraping in termini semplici?

Se dovessi rispondere a cosa si intende per web scraping in una frase, direi che è il processo di raccolta automatica di informazioni visibili dalle pagine web e la loro trasformazione in dati strutturati.

Per questo motivo viene spesso utilizzato nei flussi di lavoro di monitoraggio, raccolta di dati pubblici e ricerca.

Come funziona il web scraping passo dopo passo?

A livello di base, il funzionamento del web scraping segue una sequenza.

Uno scraper richiede una pagina, legge il contenuto HTML o renderizzato, identifica gli elementi di destinazione, estrae i campi necessari e li salva in un formato strutturato come JSON o CSV.

Quali sono i pro e i contro del web scraping?

I principali pro e contro del web scraping si riducono alla flessibilità e all'affidabilità.

Lo scraping è flessibile perché può raccogliere dati pubblici anche quando non esistono API, ma è anche più fragile, più gravoso dal punto di vista della manutenzione e di solito è meno adatto alle esperienze dei siti web rivolte ai clienti.

Quali sono i principali vantaggi dell'utilizzo delle API?

I principali vantaggi dell'uso delle API sono la struttura, la coerenza e la ripetibilità.

Le API di solito restituiscono dati più puliti, dipendono meno dalle modifiche della pagina front-end e sono più facili da collegare a flussi di lavoro a lungo termine.

È possibile utilizzare il web scraping per i dati dei social media?

Sì, il web scraping dei dati dei social media è possibile in alcune situazioni.

Ma, in base alla mia esperienza, è molto meno affidabile quando l'obiettivo è quello di pubblicare quel contenuto su un sito web attivo, dove la formattazione, la freschezza e la moderazione contano.

Perché i feed sociali scraped si rompono così spesso?

I feed scraped spesso si rompono perché dipendono dalla struttura della pagina.

Se una piattaforma cambia la modalità di rendering di didascalie, miniature, schede multimediali o altri elementi, lo scraper potrebbe smettere di restituire dati completi o coerenti.

Quando ha ancora senso il web scraping?

Il web scraping ha ancora senso per la ricerca, l'ascolto sociale, la raccolta di dati pubblici e alcuni esperimenti interni.

Divento molto più cauto nel consigliarlo quando il contenuto è destinato a un'esperienza di marca rivolta al cliente.

Qual è la differenza tra un'API diretta e una piattaforma di aggregazione?

Un'API diretta consente di accedere direttamente ai dati di origine.

Una piattaforma di aggregazione prende questo accesso e lo trasforma in un flusso di lavoro utilizzabile, aiutandovi a raccogliere, moderare, organizzare e pubblicare contenuti da più fonti.

Posso visualizzare i contenuti dei social media sul mio sito web senza effettuare lo scraping?

Sì.

In effetti, per la maggior parte dei marchi, questa è la strada migliore. Un flusso di lavoro di aggregazione basato su API consente di raccogliere prove sociali attraverso le connessioni ufficiali e di pubblicarle attraverso widget, caroselli, gallerie o feed di recensioni, senza affidarsi a metodi di scraping poco affidabili.

Il web scraping è più economico delle API?

Non sempre.

Lo scraping può sembrare più economico all'inizio, ma l'onere della manutenzione a lungo termine spesso cambia il quadro dei costi una volta che si aggiungono le correzioni, il monitoraggio, i problemi di formattazione e le rotture rivolte al pubblico.

L'aggregazione dei social media basata su API è migliore per i brand?

Per la maggior parte dei marchi, sì.

Quando l'obiettivo è mantenere un sito web fresco con contenuti affidabili per i clienti, l'aggregazione basata su API è di solito il sistema migliore a lungo termine, perché supporta la raccolta, la moderazione e la pubblicazione in un unico flusso di lavoro.